ในยุคที่โลกการทำงานดิจิทัลเปลี่ยนเร็วแบบก้าวกระโดด AI ไม่ได้เป็นแค่เทคโนโลยีล้ำ ๆ สำหรับทดลองอีกต่อไป แต่กำลังกลายเป็น “เพื่อนร่วมงาน” ที่ช่วยคิด ช่วยทำ และช่วยลดภาระงานซ้ำ ๆ ให้คนในองค์กร บทความนี้จะชวนคุณมาทำความรู้จักกับ Microsoft 365 Copilot ผู้ช่วย AI สายทำงานที่ถูกฝังมาในแอปที่เราคุ้นเคยกันดี ไม่ว่าจะเป็น Word, Excel, PowerPoint, Outlook และ Teams

จุดเด่นที่ทำให้ Copilot แตกต่างจาก AI ทั่วไป คือมันไม่ได้ทำงานแบบ “ถามอะไรก็ตอบหมด” แต่ทำงานอยู่ภายในสภาพแวดล้อม Microsoft 365 ขององค์กรอย่างปลอดภัย ใช้ข้อมูลเฉพาะที่ผู้ใช้มีสิทธิ์เข้าถึงจริงเท่านั้น ผลลัพธ์ที่ได้จึงมีบริบท เข้าใจงาน และยังสอดคล้องกับนโยบายด้านความปลอดภัย การกำกับดูแลข้อมูล และ compliance ที่องค์กรกำหนดไว้

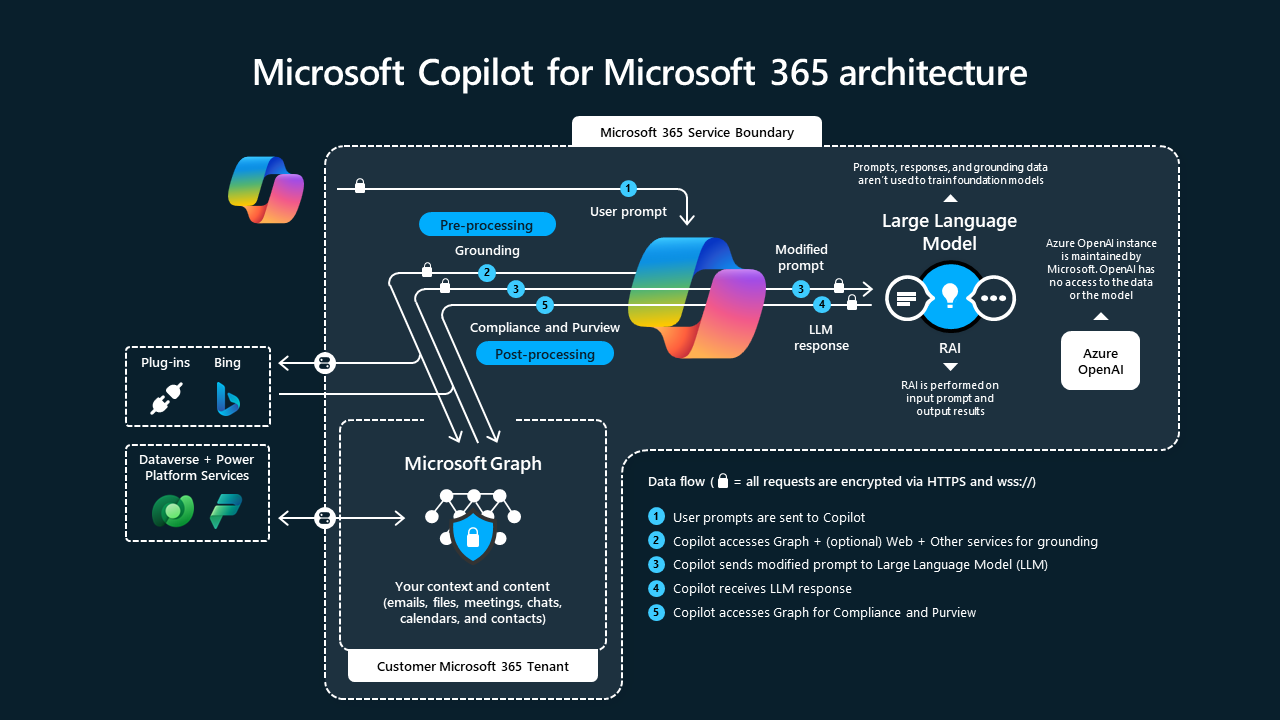

ในมุมเทคนิค บทความนี้จะพาคุณไปดูเบื้องหลังการทำงานของ Copilot ตั้งแต่การใช้ Microsoft Graph เพื่อดึงสัญญาณบริบทจากอีเมล ไฟล์ การประชุม ไปจนถึงการทำงานร่วมกับ orchestration services และ Large Language Models (LLMs) เพื่อแปลงคำสั่งภาษาคนให้กลายเป็นผลลัพธ์ที่ใช้งานได้จริง พร้อมอธิบายสถาปัตยกรรมในภาพใหญ่ ว่าทำไม Copilot ถึง “ฉลาดขึ้น” ได้โดยไม่ละเมิดความปลอดภัยของข้อมูล

อีกประเด็นสำคัญที่หลายองค์กรเริ่มให้ความสนใจคือ “Agents” ซึ่งเป็นเครื่องมืออัจฉริยะที่ออกแบบมาเพื่อทำงานเฉพาะทางมากขึ้น เช่น ตอบคำถามจากข้อมูลภายใน อัตโนมัติกระบวนการทำงาน หรือแนะนำสิ่งที่เหมาะกับผู้ใช้แต่ละคน บทความนี้จะสรุปภาพรวมของ agents ทั้งแบบสำเร็จรูปและแบบ custom พร้อมเปรียบเทียบกับ Copilot ในแง่บทบาทการใช้งาน โมเดล License และแนวทางการนำไปใช้จริงในองค์กร

ตลอดทั้งบทความ คุณจะได้เห็นตัวอย่างการใช้งานจริงและแนวคิดเชิงปฏิบัติที่สามารถนำไปต่อยอดได้ทันที ไม่ว่าคุณจะเป็นสาย IT Admin ที่ต้องดูแลความพร้อมของระบบ หรือผู้ใช้งานทั่วไปที่อยากทำงานให้เร็วและฉลาดขึ้น เนื้อหานี้จะช่วยปูพื้นฐานสำคัญในการใช้ AI เพื่อเพิ่ม productivity ลดงานซ้ำซ้อน และขับเคลื่อนนวัตกรรมในองค์กรได้อย่างมั่นใจและยั่งยืน

มาทำความรู้จักกับ Microsoft 365 Copilot กันอีกครั้ง

ในฐานะคนทำงานสาย Microsoft 365 และในมุมของ Microsoft 365 MVP บทความนี้อยากพาคุณมาทำความเข้าใจ Microsoft 365 Copilot ในเชิงเทคนิคแบบอ่านง่าย ว่าจริง ๆ แล้ว Copilot ทำงานอย่างไร และทำไมมันถึง “ฉลาดแบบรู้บริบทงานของเรา” มากกว่า AI ทั่วไป

Microsoft 365 Copilot คือผู้ช่วย AI แบบ generative AI ที่ถูกฝังอยู่โดยตรงในแอปที่เราใช้งานทุกวัน เช่น Word, Excel, PowerPoint, Outlook และ Teams จุดสำคัญที่หลายคนอาจยังไม่รู้คือ Copilot ไม่ได้ทำงานแบบ AI สาธารณะ แต่ทำงานอยู่ภายใน Microsoft 365 tenant ขององค์กรเท่านั้น นั่นหมายความว่า Copilot จะเห็นและใช้ข้อมูลได้เฉพาะสิ่งที่ผู้ใช้ที่ล็อกอินอยู่ “มีสิทธิ์เข้าถึงอยู่แล้ว”

ข้อมูลเหล่านี้ครอบคลุมตั้งแต่ไฟล์ เอกสาร แชต อีเมล ปฏิทิน ไปจนถึงข้อมูลการทำงานร่วมกันต่าง ๆ ที่เชื่อมโยงผ่าน Microsoft Graph ผลลัพธ์ที่ Copilot สร้างออกมาจึงไม่ได้เป็นคำตอบลอย ๆ แต่เป็นคำตอบที่อิงกับข้อมูลจริงขององค์กร และมีบริบทตรงกับงานของผู้ใช้แต่ละคน

สถาปัตยกรรม Microsoft 365 Copilot

ในมุมของผู้เขียนที่ทำงานกับ Microsoft 365 มาอย่างต่อเนื่อง สิ่งแรกที่อยากชวนผู้อ่านทำความเข้าใจก่อนบริหาร Microsoft 365 Copilot คือ Copilot ไม่ใช่แอปตัวเดียวจบ แต่เป็นชุดความสามารถอัจฉริยะที่ฝังอยู่ในแอป Microsoft 365 ต่าง ๆ ตั้งแต่ Word, Excel, PowerPoint ไปจนถึง Outlook และ Teams

ในเชิงสถาปัตยกรรม Copilot ขับเคลื่อนด้วยองค์ประกอบหลัก 3 ส่วนที่ทำงานร่วมกันอย่างเป็นระบบ ได้แก่

- Microsoft Graph ทำหน้าที่เป็นชั้นข้อมูล เชื่อมต่อไฟล์ อีเมล แชต ปฏิทิน และข้อมูลการทำงานร่วมกันต่าง ๆ อย่างปลอดภัย

- Orchestration service ที่จัดการ prompt กติกา และบริบทของงาน

- Large Language Models (LLMs) ที่แปลงข้อมูลและคำสั่งให้กลายเป็นคำตอบในภาษาที่มนุษย์เข้าใจง่าย

จุดแข็งของ Copilot คือความสามารถในการ “ปรับตัวตามงานที่ผู้ใช้กำลังทำอยู่” ไม่ว่าจะเป็นการร่างเอกสาร วิเคราะห์ข้อมูล หรือสรุปการประชุม Copilot จะดึงเฉพาะข้อมูลในองค์กรที่ผู้ใช้คนนั้นมีสิทธิ์เข้าถึงอยู่แล้วมาใช้เป็นบริบทในการสร้างคำตอบ ทำให้ผลลัพธ์มีความเกี่ยวข้องกับงานจริง ไม่ใช่คำตอบแบบกว้าง ๆ

เมื่อผู้ใช้พิมพ์คำสั่ง เช่น “ช่วยสรุปอีเมลชุดนี้” หรือ “สร้างแผนโปรเจกต์จากการประชุมสัปดาห์ที่แล้ว” Copilot จะเริ่มจากการเรียกข้อมูลที่เกี่ยวข้องผ่าน Microsoft Graph จากนั้นนำข้อมูลไปผ่านกติกาและบริบทใน orchestration service ก่อนส่งต่อให้ LLM สร้างคำตอบออกมา กระบวนการทั้งหมดนี้เกิดขึ้นภายใต้ขอบเขตความปลอดภัยของ Microsoft 365 tenant

สิ่งที่ IT Admin ควรตระหนักคือ คุณภาพของผลลัพธ์จาก Copilot ขึ้นอยู่กับโครงสร้างข้อมูลขององค์กรโดยตรง ไม่ว่าจะเป็นการกำหนดสิทธิ์แบบ role-based, การจัดการข้อมูลที่เป็นระเบียบ หรือการตั้งค่านโยบายด้าน security และ compliance ข้อมูลที่ชัดเจนและนโยบายที่ถูกออกแบบมาอย่างดี ไม่เพียงช่วยให้ Copilot ทำงานได้แม่นยำขึ้น แต่ยังช่วยให้องค์กรใช้งาน AI ได้อย่างมั่นใจและสอดคล้องกับข้อกำหนดด้านความปลอดภัยในระยะยาวด้วย

Microsoft Graph

หัวใจสำคัญที่ทำให้ Microsoft 365 Copilot “เข้าใจงานของเรา” ได้จริง คือ Microsoft Graph ซึ่งถือเป็นกระดูกสันหลังของความฉลาดทั้งหมดใน Copilot

Large Language Models (LLM)

อีกหนึ่งฟันเฟืองสำคัญที่ทำให้ Microsoft 365 Copilot คิด วิเคราะห์ และสื่อสารได้เหมือนมนุษย์ คือ Large Language Models (LLMs) ซึ่งเปรียบเสมือน “สมอง” ของ Copilot หาก Microsoft Graph คือแหล่งข้อมูลและบริบท LLM ก็คือกลไกที่ตีความคำสั่งและสร้างคำตอบออกมาเป็นภาษาคน

LLMs ที่ Copilot ใช้งานถูกโฮสต์อยู่บน Azure OpenAI Service และถูกปรับแต่งมาเพื่อการใช้งานระดับองค์กรโดยเฉพาะ ไม่ว่าจะเป็นการร่าง proposal สรุปรายงาน วิเคราะห์สเปรดชีต หรือสรุปการประชุม ผลลัพธ์ที่ได้จึงดูเป็นมืออาชีพและเหมาะกับบริบทธุรกิจ มากกว่า LLM สำหรับผู้ใช้ทั่วไป

สิ่งที่ทำให้ LLMs ของ Copilot แตกต่าง คือการทำงานภายใต้แนวคิด grounded AI ทุก prompt จะไม่ถูกส่งตรงไปหาโมเดลทันที แต่จะถูก “เติมบริบท” จาก Microsoft Graph และกรองผ่านกติกาของระบบก่อนเสมอ เพื่อให้คำตอบที่ออกมาทั้งรู้บริบทและสอดคล้องกับนโยบายองค์กร ข้อมูลทั้งหมดถูกประมวลผลในสภาพแวดล้อมแบบ tenant-isolated จึงไม่หลุดไปปะปนกับข้อมูลสาธารณะหรือชุดฝึกของโมเดลทั่วไป

Copilot ใช้ LLMs อย่างไรในทางปฏิบัติ

Grounded prompting

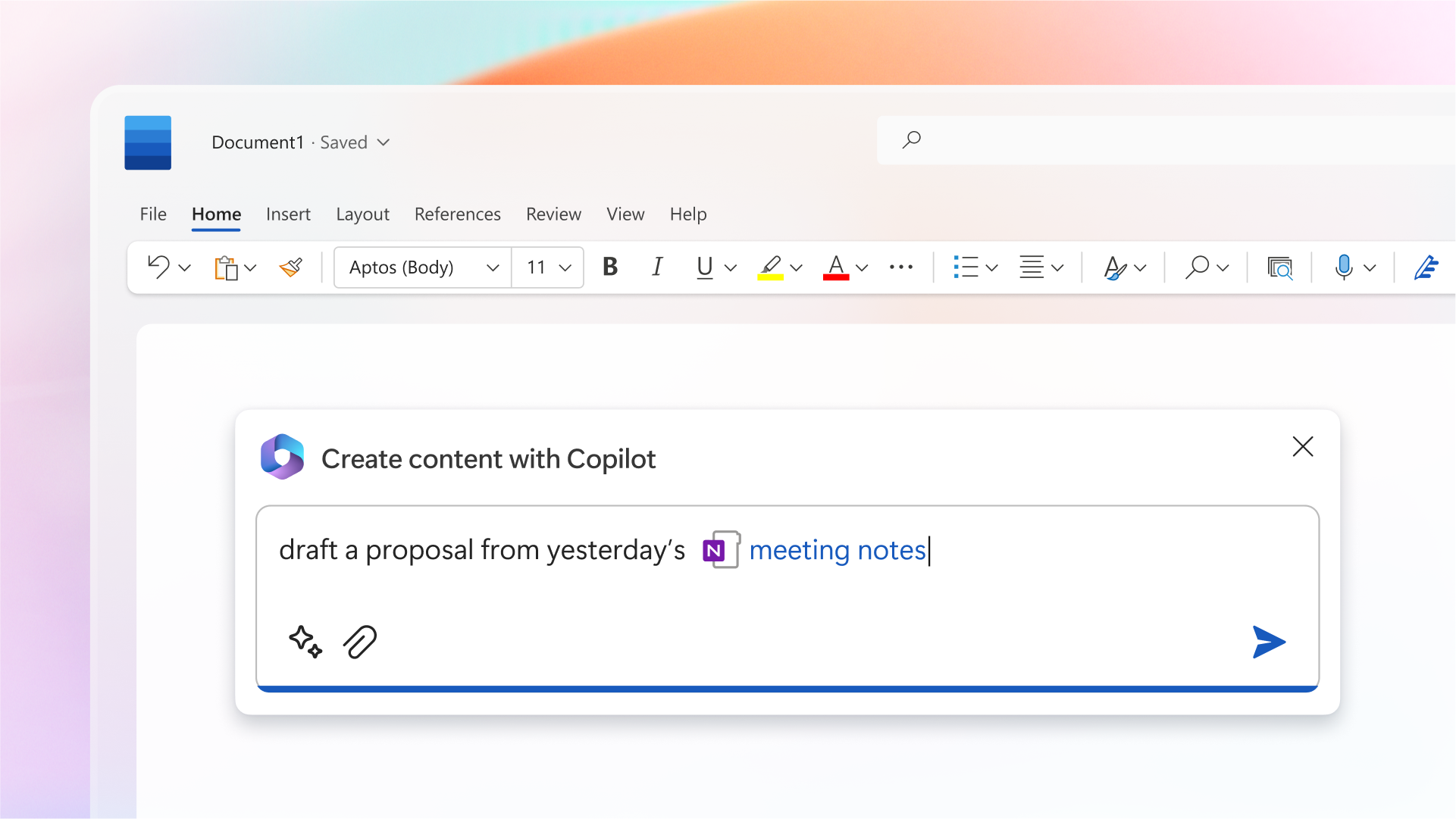

เมื่อผู้ใช้พิมพ์คำสั่ง เช่น “ช่วยร่าง project proposal” Copilot จะดึงอีเมล เอกสาร และบันทึกการประชุมที่เกี่ยวข้องจาก Graph พร้อมเพิ่ม system instruction เช่น รูปแบบเอกสารเชิงธุรกิจ ก่อนส่งให้ LLM ประมวลผล ผลลัพธ์ที่ได้จึงไม่ใช่ proposal กลาง ๆ แต่เป็นเอกสารที่อิงกับบริบทงานจริงขององค์กร

Output generation

หลังจากได้ grounded prompt แล้ว LLM จะสร้างคำตอบที่สมดุลระหว่างเจตนาผู้ใช้กับ enterprise guardrails เช่น การสรุปงบ Q3 จะเน้นแนวโน้มและความเปลี่ยนแปลง โดยไม่แต่งข้อมูลขึ้นมา จากนั้น orchestration layer จะจัดรูปแบบให้เหมาะกับแอปปลายทาง ไม่ว่าจะเป็น Word, Excel หรือ PowerPoint

คุณสมบัติสำคัญของ LLMs ใน Copilot

Isolation & security

ข้อมูลขององค์กรไม่ถูกนำไปฝึกหรือปรับปรุงโมเดลสาธารณะของ GPT ตัวอย่างเช่น หากสำนักงานกฎหมายใช้ Copilot สรุปคดีความลับ ข้อมูลนั้นจะยังคงอยู่ภายใน tenant เท่านั้น ตอบโจทย์ทั้ง compliance และความสบายใจขององค์กร

Fine-tuning เพื่อธุรกิจ

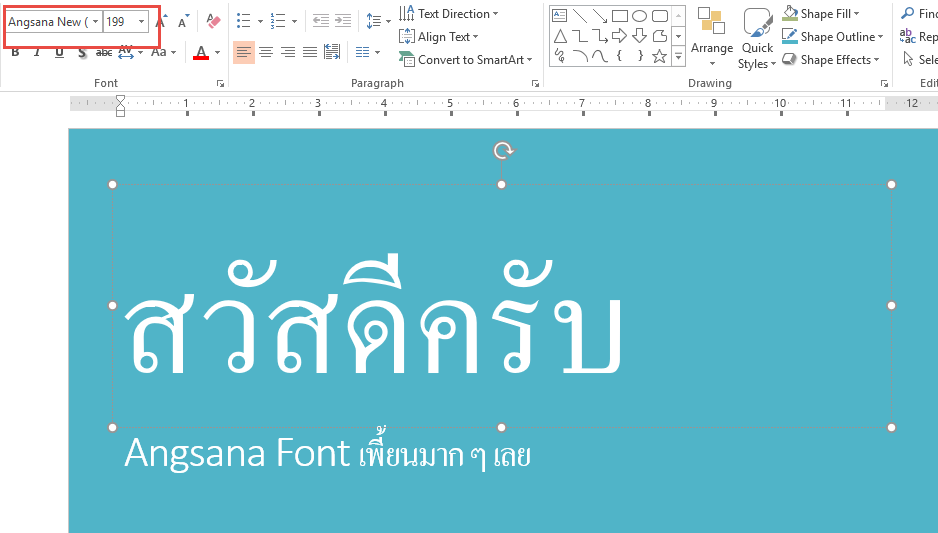

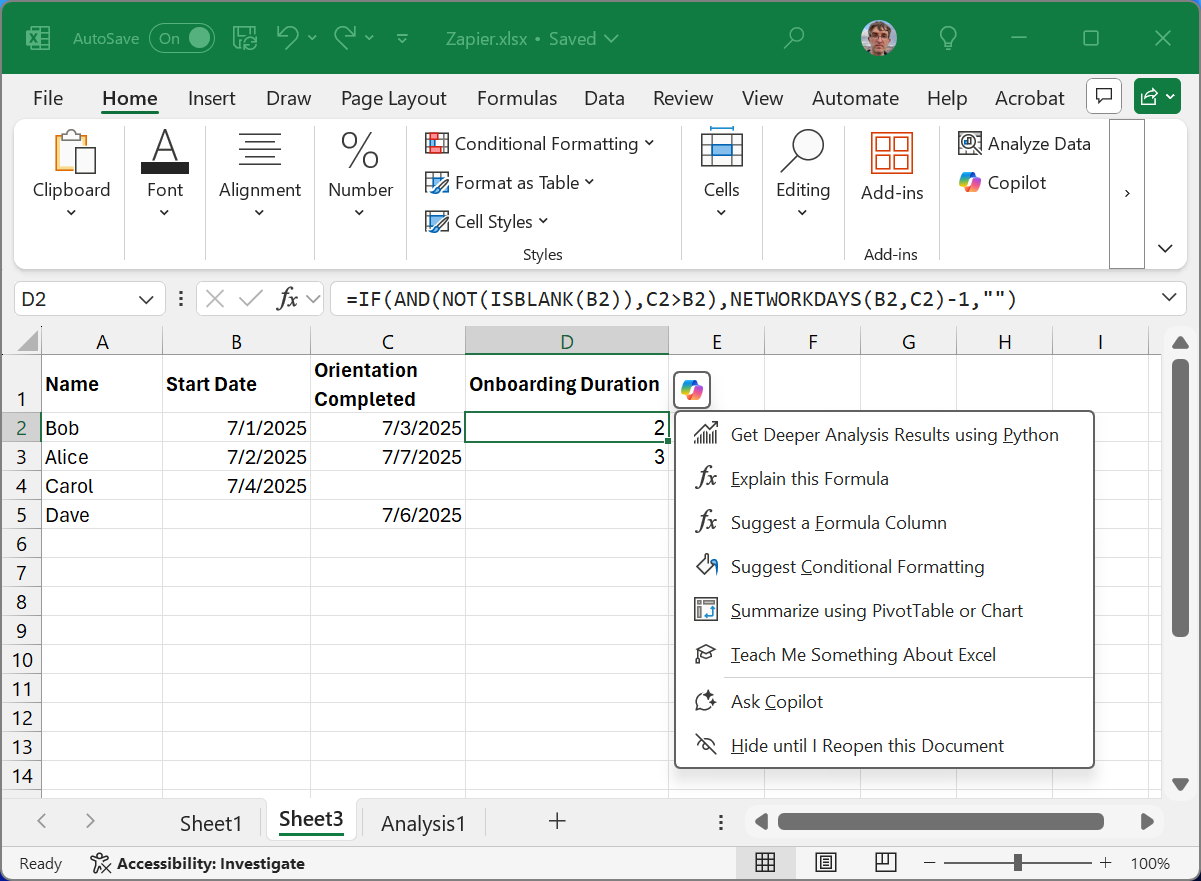

นอกจากโมเดลภาษาพื้นฐาน Microsoft ยังเพิ่มชั้นความปลอดภัยและการปรับแต่งเชิงธุรกิจ ทำให้ LLM เข้าใจบทบาท งาน และ workflow ในองค์กร เช่น Copilot ใน Excel สามารถอธิบายสูตรซับซ้อนและแนะนำวิธีปรับให้เข้าใจง่าย ซึ่ง LLM ทั่วไปมักทำได้ไม่เสถียร

Scalability ระดับองค์กร

LLMs บน Azure ถูกออกแบบมาให้รองรับการใช้งานพร้อมกันจำนวนมาก ไม่ว่าจะมีผู้ใช้ 10 หรือ 10,000 คน ระบบก็ยังคงตอบสนองได้เร็วและแม่นยำ เช่น ช่วงสรุปผลงานประจำไตรมาสที่หลายทีมเรียกใช้งาน Copilot พร้อมกัน

สรุปในมุมมองของผม:

LLMs ทำให้ Copilot “คิดเป็น” แต่สิ่งที่ทำให้มัน คิดได้อย่างปลอดภัยและเหมาะกับองค์กร คือการผสาน Graph, orchestration และการออกแบบด้าน security ตั้งแต่ต้น นี่คือเหตุผลที่ Copilot ไม่ใช่แค่ AI เก่งภาษา แต่เป็น AI ที่พร้อมใช้งานจริงในระดับ enterprise.

Microsoft 365 Apps

อีกชิ้นส่วนที่ทำให้ Microsoft 365 Copilot ถูกออกแบบมาให้ “ใช้งานได้จริงในชีวิตประจำวัน” คือการฝังตัวโดยตรงอยู่ใน Microsoft 365 apps ที่ผู้ใช้คุ้นเคยอยู่แล้ว ไม่ว่าจะเป็น Word, Excel, PowerPoint, Outlook หรือ Teams ผู้ใช้ไม่ต้องเรียนรู้แพลตฟอร์มใหม่ แต่สั่งงาน Copilot ผ่านหน้าจอและ workflow เดิมที่ใช้อยู่ทุกวัน

Native UI integration: AI ที่อยู่ถูกที่ ถูกเวลา

Copilot ถูกออกแบบให้แสดงผลอยู่ในจุดที่เหมาะสมของแต่ละแอป เช่น

- ใน Word จะเป็น pane สำหรับช่วยร่างเนื้อหา สรุปข้อความ หรือเขียนต่อจาก draft เดิม

- ใน Excel ผู้ใช้สามารถพิมพ์ภาษาคน เช่น “แสดงแนวโน้มยอดขายย้อนหลัง 5 ปี” แล้วให้ Copilot สร้างสูตร วิเคราะห์ข้อมูล หรือทำกราฟให้ทันที

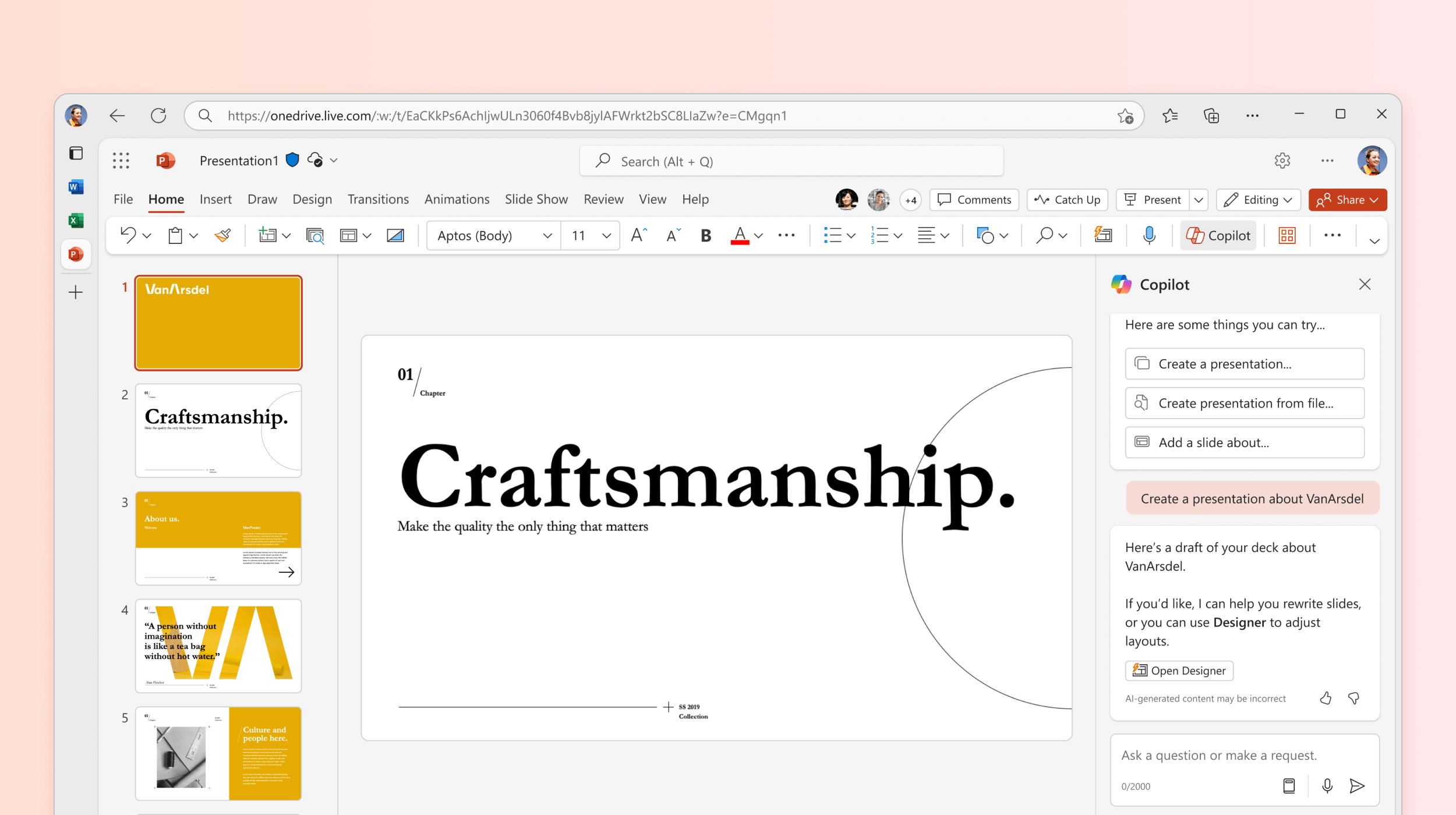

- ใน PowerPoint Copilot สามารถแปลง outline หรือเอกสารยาว ๆ ให้กลายเป็นสไลด์พร้อมโครงสร้างและ visual

- ใน Outlook Copilot ช่วยสรุปอีเมลยาว ๆ หรือร่างคำตอบที่ดูเป็นทางการ

- ใน Teams Copilot ช่วยสรุปการประชุม พร้อมดึง action items และประเด็นสำคัญขึ้นมาให้ติดตามต่อได้ง่าย

การฝังตัวแบบ native นี้ทำให้ Copilot ไม่รู้สึกเหมือน “ปลั๊กอินเสริม” แต่เป็นผู้ช่วยที่อยู่ในจังหวะการทำงานจริงของผู้ใช้

Cross-app orchestration: เชื่อมข้ามแอป ลดงานมือ

อีกจุดที่ Copilot โดดเด่นมากคือความสามารถในการทำงานข้ามแอป (cross-app orchestration) Copilot สามารถดึงข้อมูลจากหลายแหล่งมาประกอบกันได้ เช่น

“ช่วยสร้าง presentation จากรายงาน Word ของสัปดาห์ที่แล้ว และอัปเดตสถานะโปรเจกต์จาก SharePoint”

Copilot จะดึงตัวเลขจาก Excel เนื้อหาจาก Word และข้อมูลอัปเดตจาก Teams หรือ SharePoint มารวมเป็น output เดียวที่สอดคล้องกัน ลดงาน copy-paste และลดความเสี่ยงเรื่องข้อมูลไม่ตรงกันระหว่างเอกสาร

User control & feedback: ผู้ใช้ยังเป็นคนคุมเกม

แม้ Copilot จะช่วยทำงานได้เยอะ แต่ผู้ใช้ยังคงควบคุมผลลัพธ์ได้เต็มที่ หากผลลัพธ์รอบแรกยังไม่ตรงใจ สามารถปรับ prompt เพิ่มรายละเอียด หรือขอแก้ไขได้ทันที Copilot ถูกออกแบบมาให้ “คุยงานกันไปเรื่อย ๆ” ไม่ใช่สั่งครั้งเดียวจบ

นอกจากนี้ ผู้ใช้ยังสามารถลบประวัติการโต้ตอบ และส่ง feedback เมื่อคำตอบไม่ถูกต้องหรือไม่เป็นประโยชน์ ซึ่งช่วยให้ระบบพัฒนาได้ดีขึ้น โดยยังอยู่ภายใต้กรอบความเป็นส่วนตัวของข้อมูลองค์กร

สรุปในมุมของผม:

การที่ Copilot ฝังตัวอยู่ใน Microsoft 365 apps และทำงานข้ามแอปได้อย่างลื่นไหล คือเหตุผลสำคัญที่ทำให้มันกลายเป็น AI ผู้ช่วยประจำวัน ไม่ใช่แค่เครื่องมือทดลอง การออกแบบแบบนี้ช่วยลด friction ในการใช้งาน เพิ่ม productivity และทำให้ AI กลายเป็นส่วนหนึ่งของ workflow องค์กรอย่างแท้จริง

Copilot orchestration service

อีกกลไกที่หลายคนไม่ค่อยเห็น แต่ถือเป็น “ห้องเครื่อง” ของ Microsoft 365 Copilot คือ Copilot orchestration service ถ้าเปรียบง่าย ๆ นี่คือ traffic controller ที่คอยกำกับว่า prompt ของผู้ใช้ ข้อมูลจาก Microsoft 365 และ LLM จะทำงานร่วมกันอย่างไรให้ ได้ผลลัพธ์ที่ตรงงาน ปลอดภัย และไม่หลุดนโยบายองค์กร

Copilot ไม่ได้ส่งคำสั่งของผู้ใช้ไปหา LLM ตรง ๆ แต่ orchestration service จะเป็นตัวกลางที่ประเมิน เติมบริบท และควบคุมทุกขั้นตอน ตั้งแต่รับคำสั่งจนถึงแสดงผลในแอปปลายทาง เพื่อให้ทุกคำตอบอยู่ภายใต้ enterprise rules

Copilot orchestration service ทำงานอย่างไร

Prompt intake – รับและจัดประเภทคำสั่ง

เมื่อผู้ใช้พิมพ์คำสั่ง เช่น “สรุปอีเมลนี้” หรือ “สร้างแผนโปรเจกต์จากการประชุมสัปดาห์ที่แล้วและไฟล์งบประมาณ” orchestration service จะรับ prompt เข้ามา วิเคราะห์ความซับซ้อน และจัดประเภทคำขอ เพื่อเตรียมเข้าสู่ขั้นตอนถัดไป

Evaluation – เลือกข้อมูลที่จำเป็นจริง

จากนั้น orchestrator จะตัดสินใจว่าต้องใช้ข้อมูลจากแหล่งไหนบ้าง เช่น ถ้าเป็นเรื่องการเงิน ก็จะดึงข้อมูลจาก Excel ผ่าน Microsoft Graph และตัดข้อมูลที่ไม่เกี่ยวข้องออก การทำแบบนี้ช่วยลดภาระการประมวลผล และทำให้คำตอบแม่นยำขึ้น

Enrichment – เติมบริบทให้ prompt

ขั้นตอนนี้คือหัวใจสำคัญ orchestrator จะดึงข้อมูลที่เกี่ยวข้อง เช่น meeting notes จาก Teams เอกสารจาก SharePoint รวมถึงกติกาและรูปแบบตามนโยบายองค์กร แล้วนำมารวมกันเป็น grounded prompt ที่ชัดเจน ลดโอกาสที่ LLM จะตอบกว้างหรือคลาดเคลื่อน

Execution – ส่งให้ LLM ประมวลผล

grounded prompt จะถูกส่งไปให้ LLM สร้างคำตอบในภาษาธรรมชาติ เช่น การเขียนสรุปผลการดำเนินงานรายไตรมาส โดยอิงข้อมูลจริงที่ถูกรวบรวมมาแล้ว

Formatting & compliance – จัดรูปแบบและตรวจนโยบาย

สุดท้าย orchestration service จะจัดรูปแบบผลลัพธ์ให้เหมาะกับแอป เช่น เป็นเอกสารใน Word หรือสไลด์ใน PowerPoint พร้อมตรวจสอบ sensitivity label, DLP และ governance policy ก่อนแสดงผลให้ผู้ใช้

ขยายขีดความสามารถด้วย plugins และ connectors

นอกจากข้อมูลใน Microsoft 365 แล้ว orchestration service ยังรองรับ plugin และ connector ไปยังระบบภายนอก เช่น CRM, ERP หรือ HR system ทำให้ Copilot เชื่อมต่อกับ line-of-business apps ได้ เช่น ทีมขายใช้ Copilot ดึงข้อมูลจาก CRM มาสร้าง sales forecast presentation อัตโนมัติ โดยผู้ดูแลระบบสามารถควบคุมได้ว่าอนุญาตให้เชื่อมต่อระบบใดบ้าง

สรุปในมุมมองของผม:

Copilot orchestration service คือเหตุผลที่ Copilot ไม่ใช่แค่ AI ตอบเก่ง แต่เป็น AI ที่ตอบได้อย่างมีโครงสร้าง คุมความเสี่ยง และพร้อมใช้งานระดับองค์กร ยิ่งองค์กรมี data governance และ policy ที่ชัด Orchestration ก็ยิ่งทำให้ Copilot แสดงศักยภาพออกมาได้เต็มที่และปลอดภัยมากขึ้น

![[Tips] แก้ปัญหา Font ตัวเล็กใน Edge แบบถาวร](https://www.mvpskill.com/wp-content/uploads/2018/05/windows10_rez2.jpg)

![[Review] การสอบ Microsoft Certification จากที่บ้าน](https://www.mvpskill.com/wp-content/uploads/2020/04/cert3-218x150.jpg)

![[สรุปงาน] งานสัมนา Power Platform ว่าด้วยการนำ Power BI / Power Apps / Power Automate (Microsoft Flow) ไปใช้แก้ปัญหาในที่ทำงาน](https://www.mvpskill.com/wp-content/uploads/2020/01/Power-Platform-Website-218x150.png)